Für Onlineräume ohne Hass und Hetze

Visual: anjariese.com

Online-Angriffe sind keine Seltenheit. Knapp 80 Prozent der Internetnutzer*innen sind im Netz bereits Hass begegnet. Besonders betroffen sind junge Erwachsene: 17 Prozent sind selbst schon Opfer von Hate Speech gewesen.1 Rassismus, Sexismus und andere Arten gruppenbezogener Menschenfeindlichkeit können Beweggründe von Hassrede sein. Die vermeintliche Anonymität der User*innen verleitet Menschen zudem, Hetze und Aggressionen online Ausdruck zu verleihen.

Gewalt kann überall dort passieren, wo sich Menschen treffen, austauschen und vernetzen. Dabei ist die digitale Welt Teil der realen, eine klare Trennung ist heute nicht mehr gegeben. Das erläuterte Ulli Grießhammer von HateAid, der den Impuls zum Ideen-Austausch gab. Die Organisation HateAid hat zum Ziel, Gewalt im Internet zu bekämpfen und so Demokratie und Meinungsfreiheit zu stärken und zu schützen. Er machte deutlich: Hass ist ein politisches Mittel und wird als solches gezielt eingesetzt. Durch organisierte Shitstorms sollen Menschen mundtot gemacht werden. Diese Technik des „Silencing“ ist insbesondere ausgehend vom rechtsextremen Spektrum dokumentiert. Eine kleine Gruppe an Menschen erzielt damit eine große Wirkung. Das Gleichgewicht von Meinungen ist somit online ungleich verteilt.

Dahinter sind organisierte Strukturen nachweisbar, die sich nach militärischen Mustern hierarchisch aufbauen und sogar Gebrauchsanleitungen und Handbücher zum Einsatz von Hate Speech produzieren. Die Folge: 54 Prozent der Nutzer*innen von Sozialen Netzwerken trauen sich nicht mehr, ihre politische Meinung im Internet offen zu schreiben, weil sie Angst haben, Hass und Hetze zu erleben. HateAid bieten Betroffenen Beratung und rechtliche Unterstützung an.2

Im Workshop tauschten die Teilnehmer*innen ihre Erfahrungen und Gedanken aus. Dabei wurde deutlich, dass sich unterscheidet, inwiefern Mobbing und Gewalt im digitalen Raum auch als solche erkannt werden. Insbesondere junge Menschen sind scheinbar so sehr an Hate Speech, Beleidigungen und Bedrohungen gewöhnt, dass eine Normalisierung digitaler Gewalt zu beobachten ist. Doch wo endet Meinungsvielfalt? Wo werden die Grenzen gesetzt?

Zusätzlich problematisch wird das Schaffen sicherer Onlineräume durch die komplexe Rechtslage. Auch wenn die Europäische Union Ansatzpunkte zur Bekämpfung digitaler Gewalt implementiert, schützt das User*innen nicht vor Inhalten, die über Server außerhalb der EU laufen. Dazu kommt, dass die Polizei nicht online Streife fährt und für die Einhaltung der Regeln sorgt. Nur was von User*innen gemeldet wird, kann auch verfolgt werden. Deswegen ist es wichtig, auch digitale Hassrede und Gewalt zur Anzeige zu bringen.

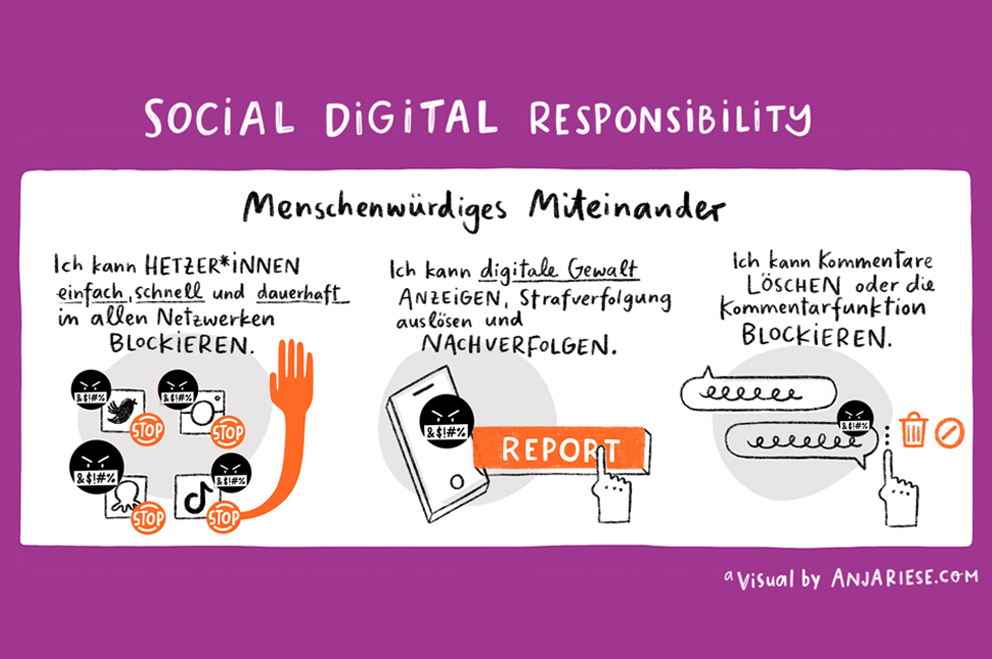

Die Forderungen der Teilnehmer*innen richten sich an Politik und Plattformen. Das Ziel sind gewaltfreie und vor allem jugendgerechte Netzwerke. Um diese zu gewährleisten, müssen Hetzer*innen in allen Sozialen Netzwerke einfach und schnell blockiert werden können. Zudem braucht es einfachere Möglichkeiten, Hasskommentare spurlos zu löschen oder die Kommentarfunktion unter Beiträgen von vornherein zu deaktivieren.

Vonseiten der Politik wünschen sich die Teilnehmenden die Einrichtung einer bundesweiten Anzeigemöglichkeit für digitale Straftaten. Vor allem muss auch nachvollziehbar sein, was mit einer Anzeige in der Folge passiert. Polizei und Strafverfolgungsbehörden müssen entsprechend geschult werden, um auf die Besonderheiten des Digitalen angemessen reagieren zu können.

In der kontroversen Diskussion wurde zudem darauf hingewiesen, dass Plattformen auch aktive Akteure sind. Sie können steuern, ob wirklich negative Nachrichten und Shitstorms bevorzugt Reichweite erhalten oder dem technisch entgegengesteuert wird. Eine „Notaus“-Option für Negativkommentare könnte hilfreich sein, Hasswellen abzuschalten.

Nicht zuletzt sind User*innen und Gesamtgesellschaft in der Pflicht, hassfreie Netzwerke mitzugestalten. Digitale Gewalt darf nicht schulterzuckend hingenommen werden, Hate Speech und die Akzeptanz dessen dürfen nicht normalisiert werden. Auch „gute Trolls“ können ihren Anteil n gewaltfreien Netzwerken haben, indem sie online positive Botschaften verbreiten und Hasskommentaren widersprechen, so ein Fazit des Workshops.

Im weiteren Prozess des Projektes werden aus dem Austausch Leitlinien für jugendgerechte soziale Netzwerke. Das ist Ziel und Aufgabe des Projektes „Social Digital Responsibility: Jungen Verbraucher*innen eine Stimme für aktive Teilhabe an Netzwerken und Plattformen geben“.

***

1 Quelle: HateSpeech Ergebnisbericht (Landesanstalt für Medien NRW, 2018), #Hass im Netz: der schleichende Angriff auf unsere Demokratie. (Campact u.a. 2019)

2 Quelle: HateSpeech Ergebnisbericht (Landesanstalt für Medien NRW, 2018), #Hass im Netz: der schleichende Angriff auf unsere Demokratie. (Campact u.a. 2019)